Прошлой осенью компания Tesla внедрила на своих автомобилях новую функцию автопилота — Navigate on Autopilot, позволяющую машине самостоятельно справляться с развязками, а также обгонять и менять полосы движения на магистрали. Только для манёвров водитель должен был давать разрешение рычажком поворота. А в прошлом месяце производитель выпустил обновление софта, позволяющее автомобилю активно действовать и без указания человека. Журнал Consumer Reports (CR) проверил функцию в деле и признал её не просто сырой, но даже «создающей угрозу безопасности движения».

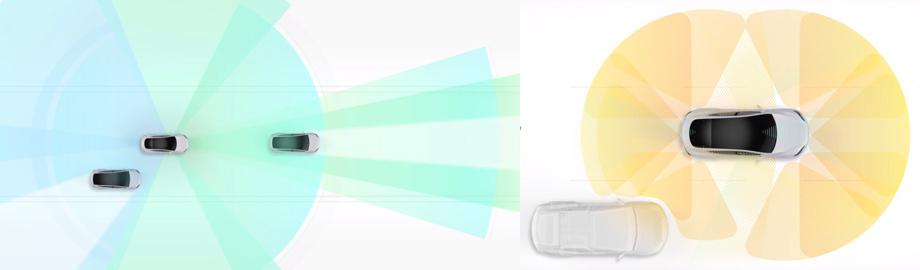

Поясним, что по умолчанию Navigate on Autopilot по-прежнему меняет полосу лишь после выдачи разрешения от водителя. Однако теперь через меню можно заранее выбрать установки системы так, чтобы позволить ей самостоятельно переходить с полосы на полосу по желанию электроники. Журнал провёл тесты, а также опросил ряд дорожных полицейских и сделал такие выводы: система откровенно близорука, действует хуже человека, не реагирует на чужие поворотники и стоп-сигналы, не может предсказать действия соседей по потоку, а оттого нередко подрезает другие машины при перестроениях, иной раз даже совершает обгоны с нарушением местных ПДД (в том или ином штате они могут в деталях отличаться).

Когда водитель отключает через меню подтверждение манёвров, на экране возникает надпись «Это всё равно не делает вашу машину по-настоящему автономной». Tesla всегда подчёркивает, что автопилот назначен в помощь человеку ради «лёгкой и расслабленной поездки», но не заменяет его и не снимает с него необходимости следить за событиями. Однако, согласно CR, «легко и расслабленно» не получается. Совсем наоборот: водителю приходится быть настороже ещё больше, поскольку Navigate on Autopilot иной раз поступает так, как аккуратный шофёр не стал бы.

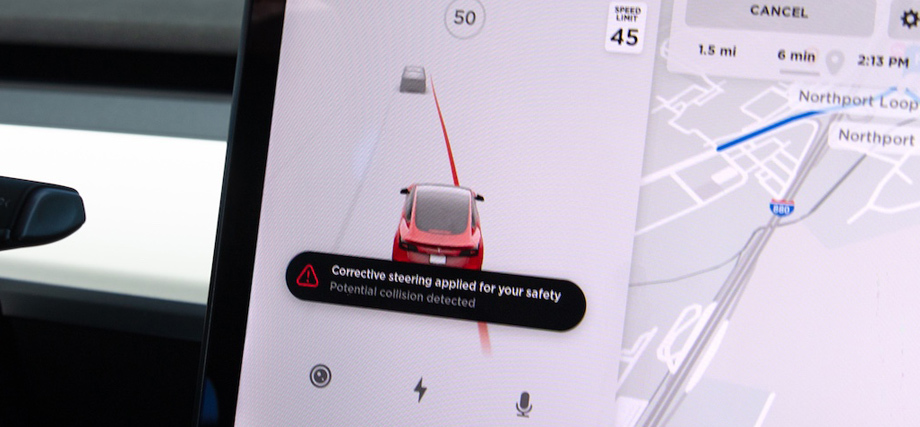

Например, автоматика обгоняла другие машины справа, когда это было запрещено. Или после слияния потоков при въезде на магистраль давала по тормозам, чтобы увеличить дистанцию до впередиидущей машины, что становилось сюрпризом для водителя последующей. Хорошо, что во всех случаях водитель Теслы мог отменить решение электроники. Например, он прилагал противоположное усилие к рулю и не давал автоматике пойти на опасный обгон с выездом на соседнюю полосу прямо перед носом другой машины, идущей с более высокой скоростью.

Указанные выше ошибки в суждениях электроники означают, что вместо расслабления водитель был в большем напряжении, чем без активации Navigate on Autopilot. Consumer Reports полагает, что Tesla выпустила на рынок продукт, который не был должным образом проверен. Tesla утверждает обратное: мол, машины прошли сотни тысяч миль проверок.

Фирму извиняет лишь чёткая и не раз звучавшая декларация: никакой автопилот не снимает с водителя ответственность за безопасность, лишь помогая вести машину. Тем не менее история с последней проверкой вновь поднимает вопрос о юридических последствиях развития автоматизированного вождения. Масла в огонь подливают и случаи гибели людей в Теслах. Последний был в марте. По предварительным данным Национального совета по безопасности на транспорте (NTSB), за десять секунд до катастрофы водитель включил автопилот.

Дополнение

Один из владельцев Теслы в частной беседе подтвердил нам, что новая смена полосы без подтверждения действительно «тормозная» и лишь «повышает напряжение», и потому он её отключил.